迪士尼研究院聯合幾所大學的研究人員撰寫的一篇新論文,其描述了一種根據深度學習實現程序語音動畫的新方法。該系統可以對人類錄音進行采樣,并自動生成匹配的口型動畫。這種方法的應用范圍十分寬廣,比如提高動畫管道的效率,以及通過實時繪制用戶講話時的虛擬化身口型動畫來使社交VR交互更具說服力。

迪斯尼研究院,東安格利亞大學,加利福尼亞理工大學和卡內基梅隆大學的研究人員撰寫了題為“A Deep Learning Approach for Generalized Speech Animation”的論文,其描述了一種已經通過“深度學習/神經網絡”方法進行訓練的系統,通過單個揚聲器的參考片段(2543句)來教導系統在各種語音單元(音素)期間應該形成的形狀及其組合,時長達8小時。

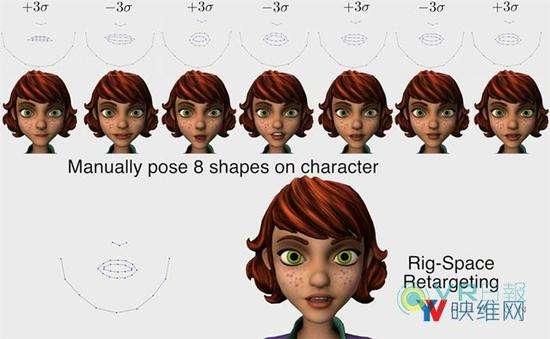

經過訓練的系統可用于分析來自任何揚聲器的音頻,并自動產生相應的口形,然后將其應用于自動語音動畫的面部模型。研究人員表示,該系統獨立于揚聲器,可以“近似計算其他語言”。

“我們使用了一種簡單有效的深度學習方法來自動生成與輸入語音同步的自然尋像語音動畫。我們的方法使用了滑動窗口預測器,其能夠準確捕捉自然運動和視覺協同發音,學習從語音標簽輸入序列到口部運動的任意非線性映射。我們的深度學習方法具有以下幾個吸引人的特性:實時運行;需要最少的參數調整;能很好地歸納新穎的輸入語音序列;容易編輯出風格化和情感化的語音;以及兼容現有的動畫重定向方法。”

創建與CGI角色音頻記錄相匹配的語音動畫通常由熟練的動畫師手工完成。盡管這個系統不能滿足大型CGI制作對高保真語音動畫的需求,但可以用于這種制作中的自動1PASS,或者是在特定情況下添加可接受的語音動畫,例如大型角色扮演游戲中NPC對話,或者是從語音動畫中受益的低預算項目(沒有辦法聘請動畫師),如教學/培訓視頻,學術項目等。

至于VR,這種系統可以在用戶說話時實時動畫化虛擬化身的口型,從而使得社交VR角色變得更加逼真。真正的口型追蹤(光學或其他)是制作虛擬化身語音動畫的最準確方法,但在口型追蹤硬件變得普遍之前,這樣的程序語音動畫系統可能是一種有效的權宜之計。

一些社交VR應用已經在使用各種系統實現語音動畫,比如Oculus為Unity提供了一個唇形同步插件,基于音頻輸入來制作虛擬化身的口型動畫。然而,這種基于深度學習的新系統似乎提供了非常高的準確性和細節度。

新浪聲明:新浪網登載此文出于傳遞更多信息之目的,并不意味著贊同其觀點或證實其描述。